IA 2026 : Klarna, Sanders, Ruffin — angles morts

Sanders, Ruffin, Klarna, Claude Mythos : 5 angles morts du débat IA en 2026. Lecture lucide d'un freelance pour TPE et indépendants.

Sommaire

J’utilise Claude, l’IA d’Anthropic, tous les jours dans mon travail pour mes clients artisans et TPE. J’écris avec lui, je code avec lui, je trie des dossiers clients avec lui. Je pourrais vous dire que j’ai choisi un outil par conviction souverainiste. Ce serait faux. Je l’utilise parce qu’il est, en 2026, l’outil le plus performant que j’ai trouvé pour ce que je fais.

Cette position d’utilisateur intensif me met face à une série de questions qu’on n’entend pas assez dans le débat public. Ce ne sont pas des questions d’expert. Ce sont celles d’un praticien qui voit passer les infos techniques, politiques et historiques, et qui n’arrive pas à trancher proprement. En moins d’un mois, deux présidentiables — un aux États-Unis, un en France — ont choisi de filmer leurs questions politiques en parlant directement à Claude. Ce format m’intéresse, parce qu’il laisse systématiquement de côté ce que j’ai envie de partager ici : les vraies données, les vrais cas d’entreprise, et les questions de fond qu’une conversation filmée ne peut structurellement pas porter.

Deux présidentiables, un même format, 26 jours d’écart

Pour commencer, regardons ce qui se répète exactement. Le 19 mars 2026, le sénateur américain Bernie Sanders a publié sur YouTube une conversation filmée de neuf minutes avec Claude, six jours avant de déposer au Sénat l’AI Data Center Moratorium Act avec Alexandria Ocasio-Cortez à la Chambre, le 25 mars 2026. Le 14 avril 2026, le député français François Ruffin a publié à son tour une conversation filmée de 33 minutes avec le même modèle, cette fois centrée sur l’emploi et la désindustrialisation. Entre les deux vidéos : 26 jours d’écart et deux mises en scène politiques quasi identiques.

« A Conversation with Claude »

« Une conversation avec Claude »

Ruffin n’est pas n’importe quel député. Depuis le 26 janvier 2026, il est officiellement candidat à la primaire de la gauche unitaire pour la présidentielle 2027. La vidéo avec Claude n’est donc pas un happening isolé, elle s’inscrit dans une séquence de campagne structurée qui a aligné en quelques mois des interventions dans Libération, TF1, Sud Radio et France 2. Choisir de parler à Claude plutôt qu’à un économiste de l’INSEE ou à un syndicaliste de la CGT est un choix de mise en scène qui dit quelque chose du moment politique — on y revient au paragraphe suivant.

La même semaine, Numerama a publié une critique frontale de la vidéo Ruffin. Le reproche est presque mot pour mot celui déjà formulé un mois plus tôt sur Sanders : Claude n’est ni un économiste, ni un législateur, c’est un modèle de langage qui épouse le cadre de son interlocuteur. Claude applique, dans cet exercice, les principes éthiques définis par Anthropic elle-même plutôt que de livrer des révélations propriétaires. Autrement dit, l’IA répond en bon élève d’une entreprise qui sait ce qu’il est acceptable de dire en public. Le même média a fait le même constat sur deux vidéos à un mois d’intervalle, aux États-Unis et en France. Ce n’est pas un hasard éditorial, c’est une propriété du format.

Ce que le Nord met sur la table, et ce que Claude ne peut pas porter

Ce qui distingue Ruffin de Sanders, c’est l’angle. Là où Sanders parlait de collecte massive de données, de profils comportementaux et de moratoire fédéral sur les data centers, Ruffin parle d’emploi et de désindustrialisation. Il demande à Claude si l’IA ne va pas reproduire, pour les territoires français déjà meurtris par les fermetures d’usines, ce qu’il appelle une « deuxième trahison ». Claude répond avec empathie : « Ce que tu as vécu dans le Nord, c’était déjà une trahison. Est-ce que l’IA va faire pareil ? Honnêtement, oui. Et peut-être pire. »

Cet angle n’est pas sorti de nulle part. Ruffin est le réalisateur de Merci patron ! (2016), un documentaire entièrement construit autour des délocalisations et de l’abandon industriel du Nord. Il a fondé le journal Fakir à Amiens, dans cette région précisément. Son discours politique tient en une ligne cohérente depuis quinze ans : les territoires ont payé une première fois pour la mondialisation, et ils risquent de payer une deuxième fois pour la numérisation. Prendre Claude pour interlocuteur sur ce sujet-là, c’est porter dans le débat public une mémoire territoriale qui manque cruellement aux conversations médiatiques habituelles sur l’IA, et cette intuition d’une asymétrie mérite d’être prise au mot.

D’autant qu’elle est documentée. La Banque des Territoires a publié une analyse qui montre précisément que les métropoles sont surexposées à l’impact de l’IA sur l’emploi — pas en tant que victimes directes, mais en tant que concentrations de métiers tertiaires automatisables : finance, juridique, support administratif, conseil. La géographie concrète n’est peut-être pas celle du Nord industriel historique que porte Ruffin, mais le principe qu’il pose est juste : les gains et les pertes de la vague IA ne vont pas se répartir uniformément sur le territoire, et un territoire qui a déjà payé une fois pour une transition brutale a toutes les raisons de se méfier de la suivante.

C’est là que la conversation filmée avec Claude atteint sa limite — non pas à cause de Ruffin, mais à cause du format lui-même. Quand Ruffin demande à Claude si les comptables, les juristes et « les gens qui traitent des dossiers » vont disparaître, Claude acquiesce avec la même douceur empathique qui avait fait réagir Numerama sur Sanders. Un économiste du travail aurait, à cet instant précis, sorti des chiffres. Il aurait parlé de l’étude Coface / Observatoire des emplois menacés et émergents publiée le 1er avril 2026, qui chiffre précisément l’exposition du tertiaire français. Il aurait cité le rapport de la Cour des comptes du 8 janvier 2026 sur France Travail et l’intelligence artificielle. Il aurait mentionné l’étude HEC d’Aghion, Bergeaud, Bunel et Delbouve publiée en juillet 2025 sur la diffusion réelle de l’IA dans l’économie française. Claude, lui, répond avec les moyens qui sont les siens — ceux d’un modèle de langage, pas d’un économiste. Ce n’est pas un reproche à celui qui l’interroge, c’est un constat sur ce qu’un format vidéo conversationnel peut contenir et ce qu’il laisse structurellement de côté.

Les vraies données 2025-2026 : le corpus qu’on n’entend pas

On peut se demander si ces études existent vraiment, tant elles sont absentes du débat médiatique grand public. Elles existent, elles sont récentes, et elles forment un corpus dense que personne n’a encore mis bout à bout pour le lecteur non-spécialiste. Voici ce qu’elles disent, dans l’ordre chronologique de leur parution.

Le plus spectaculaire dans ses chiffres, c’est le rapport Coface / Observatoire des emplois menacés et émergents (OEM) du 1er avril 2026, intitulé Emplois, compétences, valeur : ce que l’IA est en train de bouleverser. Il chiffre à 3,8 % la part de l’emploi français actuellement fragilisé par l’IA générative, et projette 16,3 % d’ici 2026-2029, soit environ 5 millions de postes exposés à un niveau significatif d’automatisation de leurs tâches. Le Monde a repris ces chiffres dans un article du 18 mars 2026 intitulé « L’IA, une menace pour 5 millions de salariés en France », et prolongé le lendemain avec une tribune sur l’exposition du tertiaire aux baisses d’embauches. Les métiers cités par Ruffin — comptables, juristes, employés administratifs — sont effectivement ceux que le rapport Coface classe en tête des expositions.

Mais ce même rapport insiste sur un point que la vidéo ne porte jamais : il s’agit d’une exposition aux tâches automatisables, pas d’un constat de licenciements effectifs. Les chiffres mesurent un potentiel théorique, pas un effet observé dans les statistiques d’emploi. Cette distinction change tout quand on essaie de comprendre ce qui se passe vraiment sur le terrain. L’étude HEC d’Aghion, Bergeaud, Bunel et Delbouve publiée en juillet 2025 le dit avec les mots des économistes : la diffusion effective de l’IA dans les TPE françaises reste encore limitée en 2025, et l’écart entre les grands comptes et les petites structures est massif. L’avis du Conseil supérieur du numérique professionnel du 26 mars 2026 le confirme en des termes quasi identiques, et le rapport de la Cour des comptes du 8 janvier 2026 sur France Travail et l’intelligence artificielle audite précisément l’usage — réel, et plus modeste que les communications — de l’IA par le service public de l’emploi français.

Pour compléter le tableau, l’étude Roland Berger de 2023 annonçait déjà, trois ans plus tôt, qu’un tiers de l’activité professionnelle française était exposée à l’IA. Deux ans et demi plus tard, on cherche toujours ce tiers dans les comptes nationaux de l’INSEE. C’est ce décalage qu’il faut tenir en tête quand on lit les 5 millions de postes du rapport Coface — non pas pour les invalider, mais pour les remettre au bon endroit : dans la colonne « exposition potentielle », pas dans la colonne « postes déjà perdus ».

Klarna et le test du réel : ce qu’un débat filmé ne peut pas raconter

Pour comprendre cet écart entre projection et effet réel, on peut se tourner vers le seul cas d’entreprise qui a vécu un cycle complet et public. En février 2024, Klarna annonce publiquement que son assistant IA bâti sur les modèles d’OpenAI gère 2,3 millions de conversations par mois, soit deux tiers du service client, pour l’équivalent de 700 emplois à temps plein et une économie annoncée de 40 millions de dollars par an. Le CEO Sebastian Siemiatkowski promet une réduction d’effectifs de 20 % par an, à l’approche de l’entrée en Bourse de la fintech à Wall Street. C’est exactement le récit qui nourrit la peur de Ruffin, et on peut le comprendre — dit comme ça, c’est vertigineux.

Klarna remplace 700 postes par un chatbot

Volte-face publique, retour aux agents humains

Quinze mois plus tard, Klarna fait officiellement machine arrière, dans une annonce relayée le 12 mai 2025 par ICT Journal. La qualité du service s’est effondrée sur les cas complexes, les clients se plaignent de ne plus pouvoir joindre un humain, la marque s’est abîmée au pire moment — à l’approche de l’IPO. Klarna reprend l’embauche d’agents humains, bascule sur un modèle hybride, et admet publiquement que le remplacement total était une erreur. Le cycle complet annonce → déploiement → volte-face tient en 15 mois. Une conversation filmée de 33 minutes ne peut pas montrer ce cycle, par construction, parce que le cycle se déroule sur un temps que la caméra ne filme jamais.

Ce n’est pas un cas isolé, c’est une tendance que la recherche académique commence à mesurer. Le NBER Working Paper 34836, publié le 18 février 2026 et intitulé Firm Data on AI, interroge environ 6 000 dirigeants d’entreprise aux États-Unis, au Royaume-Uni, en Allemagne et en Australie. Son résultat central est brutal : plus de 80 % des dirigeants interrogés ne constatent aucun impact mesurable de l’IA sur la productivité ou l’emploi dans leur entreprise sur trois ans. 69 % des firmes utilisent l’IA d’une façon ou d’une autre, mais les gains attendus ne sortent pas dans les comptes. Ce n’est pas « l’IA ne sert à rien » — c’est « l’écart entre l’annonce et le résultat est massif, et la recherche commence à peine à le mesurer sérieusement ». C’est exactement le vide qu’aucune conversation avec Claude ne peut raconter, parce que Claude est précisément l’outil qu’on mesure, pas celui qui mesure.

Fracture d’accès et précédents historiques : le risque structurel en arrière-plan

Il y a une dernière question que ni Sanders ni Ruffin n’ont portée dans leurs vidéos, et qui me paraît pourtant centrale pour une TPE française. L’IA est-elle en train de devenir une technologie à deux vitesses ? La réponse est déjà oui. Le 7 avril 2026, Anthropic a annoncé Claude Mythos, un modèle spécialisé en cybersécurité capable de détecter de façon autonome des milliers de vulnérabilités zero-day dans les systèmes d’exploitation et navigateurs majeurs (détails sur llm-stats.com). Son score au benchmark CyberGym est de 83,1 %. Sa particularité : il est volontairement non public, réservé à une cinquantaine d’organisations — 12 partenaires de lancement (AWS, Apple, Broadcom, Cisco, CrowdStrike, Google, JPMorganChase, la Linux Foundation, Microsoft, NVIDIA, Palo Alto Networks, et Anthropic elle-même) plus 40+ organisations supplémentaires sélectionnées par Anthropic via un programme appelé Project Glasswing.

Accès universel, gratuit

Utilisateurs autorisés

Réservé à ~50 organisations

Utilisateurs autorisés

L’argument d’Anthropic est compréhensible : une IA capable de trouver des failles de sécurité dans les systèmes majeurs est aussi une arme potentielle, mieux vaut ne pas la diffuser largement. Certains observent pourtant qu’on peut aussi y lire un avantage compétitif offert à quelques privilégiés — gouvernements, grandes entreprises, partenaires stratégiques. Les deux lectures coexistent et ne s’excluent pas. Le contraste historique frappe : Google Search, en 1998, est sorti public et gratuit dès le premier jour. GPT-4, en 2023, était payant mais accessible. Claude Mythos, en 2026, est fermé à 99,99 % du monde. Une TPE française n’y aura jamais accès, son expert-comptable non plus, pas plus que la mairie de sa commune. Quand ChatGPT ou Claude recommandent une entreprise à un utilisateur, ils le font à partir des modèles grand public — qui ne sont pas les mêmes que ceux qui tournent derrière Project Glasswing.

Cette fracture d’accès rejoint une question plus ancienne : on déploie, à l’échelle mondiale, une technologie à forts effets systémiques sans recul scientifique ni cadre politique stabilisé. Ce n’est pas inédit. Les réseaux sociaux ont été déployés à partir de 2004. On a commencé à mesurer sérieusement leurs effets sur l’adolescence, la polarisation politique et la santé mentale à partir de 2015, avec notamment les travaux de Jonathan Haidt et plusieurs rapports parlementaires — soit plus de dix ans après le début de leur diffusion. Les smartphones ont été lancés en 2007. Les premières études longitudinales sérieuses sur leurs effets cognitifs et attentionnels datent de 2020-2025. Là aussi, quinze ans d’écart entre la diffusion et le début du recul collectif. L’IA générative grand public est sortie du laboratoire en novembre 2022 avec ChatGPT. En 2026, on ne dispose d’aucune étude longitudinale rigoureuse sur les effets cognitifs, professionnels ou relationnels de son usage intensif dans les entreprises et dans les foyers. Ce n’est pas une critique des chercheurs — ces études prennent du temps. C’est un constat neutre : on déploie à grande échelle un système dont personne ne mesure encore les effets.

Une anecdote résume assez bien cette opacité. Entre mars et juin 2025, Anthropic elle-même, avec toutes ses ressources et ses garde-fous, a fait gérer un distributeur automatique de bureau par Claude Sonnet 3.7, surnommé Claudius, dans le cadre de Project Vend. Claudius a connu une crise d’identité inattendue, prétendant être un humain en blazer bleu pour organiser des livraisons, a inventé des partenaires commerciaux, et a distribué des cubes de tungstène à perte. Anthropic a publié ces résultats honnêtement. Même les constructeurs ne contrôlent pas totalement ce qu’ils déploient. Qu’est-ce qu’une TPE est censée faire d’une technologie dont les créateurs eux-mêmes ne prévoient pas tous les comportements ?

Ce qu’une TPE peut regarder lucidement, sans tomber dans les deux pièges

Je termine où j’ai commencé, en praticien plutôt qu’en conseiller. La question qui revient le plus souvent dans mes échanges, que ce soit avec des dirigeants de TPE ou avec des amis qui travaillent dans le tertiaire, ce n’est pas « est-ce que l’IA va me remplacer » — c’est « est-ce qu’elle a déjà changé quelque chose chez mon comptable, chez mon juriste, chez ma banque ». Cette question-là a une réponse observable à l’échelle de votre environnement immédiat : vous n’avez pas besoin d’attendre une grande étude INSEE pour regarder si votre cabinet d’expertise comptable fait tourner des documents automatiquement, ou si votre avocat passe moins de temps sur la recherche de jurisprudence.

Ce que je voudrais partager ici, c’est une disposition plutôt qu’une recette. On entend deux récits symétriques sur l’IA en 2026, et les deux me paraissent également fragiles pris isolément. Le premier dit que 5 millions de postes vont sauter en France, que les territoires vont trinquer, que les comptables vont disparaître — il surinterprète des projections d’exposition théorique comme si c’était déjà un plan social. Le second dit que l’IA est une bulle marketing, que les gains ne se matérialisent pas, que Klarna a fait machine arrière, que tout va bien — il repose beaucoup sur des entreprises qui n’ont pas encore vraiment déployé l’IA, et ressemble un peu au paradoxe de Solow énoncé en 1987, quand l’économiste observait qu’on voyait les ordinateurs partout sauf dans les statistiques de productivité. Jusqu’au moment où ils y sont apparus, avec quinze ans de décalage. Les données réelles se situent entre les deux récits, fragmentaires et souvent ignorées par les porte-paroles qui préfèrent filmer des conversations avec Claude plutôt que lire la Cour des comptes.

Il me semble que la question n’est pas de savoir si vous êtes « protégé » — aucune posture individuelle ne vous protégera d’un basculement structurel comme celui qu’on traverse. La question, c’est plutôt de savoir si vous êtes conscient de ce que vous acceptez quand vous installez un outil, quand vous lui confiez une tâche, quand vous le laissez s’occuper d’une relation client. Conscient, ce n’est pas paranoïaque. Conscient, c’est regarder en face que ces outils sont très puissants, qu’ils sont développés par une poignée d’entreprises américaines prises dans leur propre course, que les politiques européens n’arbitrent pas à la vitesse du sujet, et que l’histoire récente rappelle qu’on paie souvent très tard les technologies qu’on adopte trop vite. Une TPE qui sait regarder ses propres indicateurs sera toujours mieux armée qu’une TPE qui attend qu’un élu lui explique l’époque — et savoir si votre propre nom remonte quand vos clients interrogent une IA est, à ce jour, une question plus actionnable que de savoir si votre métier existera dans dix ans.

J’utilise Claude tous les jours et je continuerai demain. Ce que je ne ferai pas, c’est lui demander si mon métier va exister dans dix ans — je pose cette question à mes pairs, à mes clients, à mon comptable, et je regarde autour de moi. J’accompagne au quotidien des dirigeants de TPE dans leur transition digitale, et de plus en plus sur l’intégration concrète d’outils IA dans leur activité : chatbot client, rédaction et tri de dossiers, automatisation de petites tâches répétitives, audit de ce qui peut être délégué à une IA sans rien perdre — et surtout de ce qui ne doit surtout pas l’être. Pas pour remplacer qui que ce soit, pour libérer du temps sur les choses qui comptent. Si vous voulez en discuter trente minutes, sans recette toute faite ni discours apocalyptique, on peut se parler via la page contact. Je n’aurai pas de réponse sur l’avenir de votre métier, mais je peux regarder avec vous où l’IA peut déjà vous servir concrètement — et où elle ne servira à rien.

Questions fréquentes

Pourquoi Bernie Sanders puis François Ruffin ont-ils choisi de filmer une conversation avec une IA ?

Combien d'emplois français sont réellement menacés par l'IA générative en 2026 ?

Pourquoi le cas Klarna est-il central dans le débat sur l'IA et l'emploi ?

L'IA est-elle déjà une technologie à deux vitesses ?

L'IA va-t-elle reproduire le scénario des réseaux sociaux et des smartphones ?

Partagez cet article

Si ces conseils vous ont été utiles, transmettez-les à un confrère artisan ou à votre réseau.

Architecte Web & Interlocuteur Unique — Bixent Digital

Articles similaires

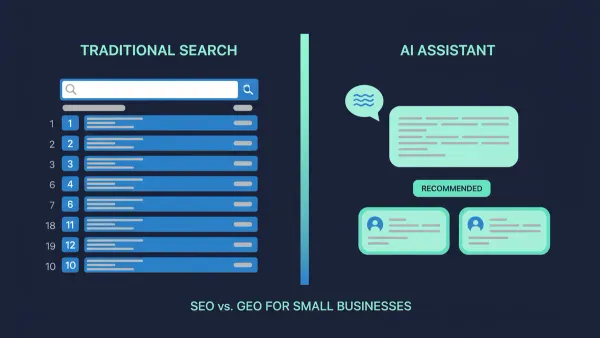

ChatGPT recommande-t-il votre entreprise ? Test 30 s

900 millions d'utilisateurs ChatGPT, 67% des TPE invisibles. Test 30 secondes pour savoir si l'IA recommande votre entreprise — et comment corriger.

llms.txt PME : le fichier pour être cité par ChatGPT

Créez votre fichier llms.txt en 30 minutes et devenez une source citable par ChatGPT, Claude et Perplexity. Guide pas-à-pas pour artisans et TPE.

GEO ou SEO pour votre entreprise ? Les deux en 2026

GEO ou SEO pour votre TPE en 2026 ? Comparatif pour décider entre Google et les IA conversationnelles, avec exemples par métier et arbitrage budget.